Amazon Bedrock Guardrailsで生成AIの安全性と信頼性を向上

Amazon Web Services (AWS)は、Amazon Bedrock Guardrailsに幻覚検出機能と独立したAPIを追加し、あらゆるモデルにおいてカスタマイズされたガードレールで生成AIアプリケーションを強化し、責任ある信頼できる出力を保証することを発表しました。

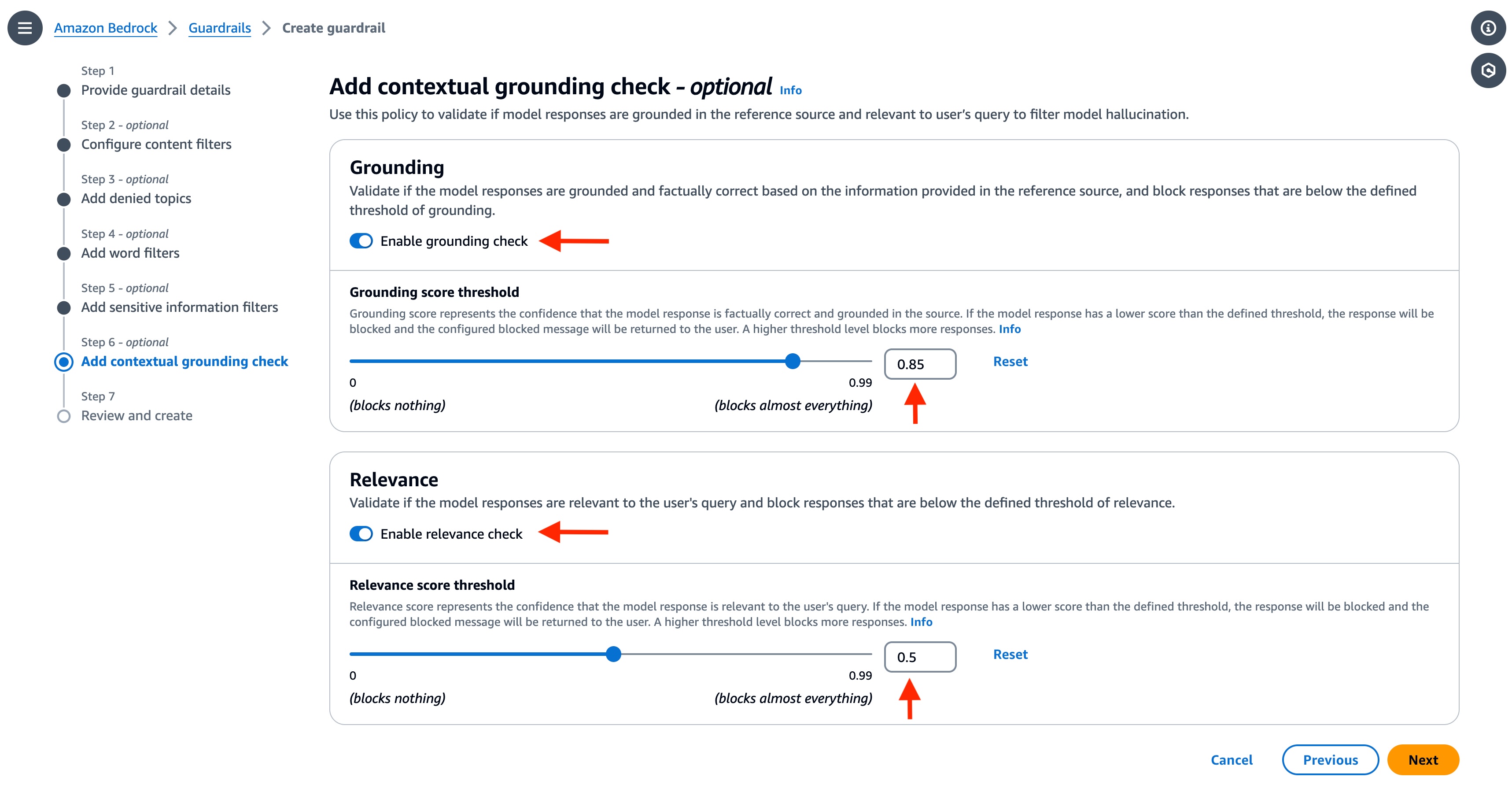

今回のアップデートで特に興味深いのは、コンテキストに基づいた根拠チェックによる幻覚検出機能の追加です。生成AIモデルは、一見もっともらしい嘘の回答(幻覚)を生成することが課題として挙げられます。今回のアップデートでは、企業データやユーザーの質問に根拠を持たない回答を検出することで、RAGや要約、情報抽出といったユースケースにおいて、より信頼性の高いアプリケーションの開発が可能になる点が画期的だと感じました。

例えば、金融業界の顧客対応アプリケーションでは、不正確な情報に対する許容度が低いため、高いしきい値を設定する必要があるでしょう。しかし、従来の生成AIモデルでは、このようなきめ細かい制御が難しく、幻覚によるリスクを完全に排除することが困難でした。Amazon Bedrock Guardrailsのコンテキストに基づいた根拠チェック機能は、このような課題を解決する有効な手段となりえます。

さらに、ApplyGuardrail APIにより、Amazon Bedrock以外のカスタムモデルやサードパーティモデルを含む全ての生成AIアプリケーションに対して、標準化された一貫性のある安全対策を適用できるようになった点も注目すべき点です。これは、企業が生成AIをより安心して活用できる環境をAWSが提供していると言えるでしょう。

生成AIは、その可能性の一方で、倫理的な問題やリスクが懸念されています。今回のAmazon Bedrock Guardrailsのアップデートは、これらの問題に積極的に取り組み、生成AIの信頼性を高めるための重要な一歩と言えるでしょう。